Uno degli svantaggi delle auto a guida autonoma è nel tempo impiegato per riconoscere gli ostacoli: ora si punta ad arrivare a 20 millisecondi.

L’etica è cruciale per lo sviluppo delle auto senza conducente. Un sito ci fa immedesimare in un’auto a guida autonoma che deve scegliere quali vite sacrificare.

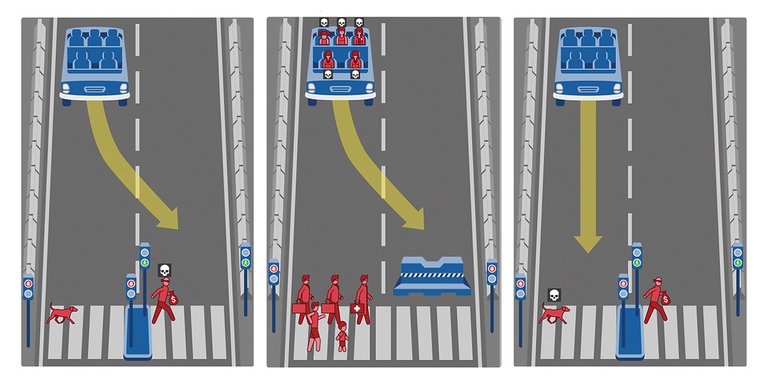

Decidete voi chi vive e chi muore. No, non è l’ennesimo film violento e dalla trama scontata. Si tratta, piuttosto, del sito Moral machine creato dal Mit (Massachusetts institute of technology) per invitare gli utenti a scegliere il “male minore” in diverse situazioni, immedesimandosi nell’intelligenza artificiale che gestisce un’auto a guida autonoma. In seguito alla rottura dei freni, ad esempio, è meglio reagire all’imprevisto salvando i passeggeri e investendo i pedoni oppure sacrificando gli occupanti dell’abitacolo a favore dei passanti? E ancora, è legittimo inserire preferenze per età, sesso e correttezza – distinguendo tra quanti rispettano il codice della strada e quanti lo violano – nell’insieme degli input che il computer è chiamato ad analizzare per scegliere chi proteggere?

Prima di arrivare sul mercato, le auto autonome dovranno imparare anche a uccidere. Se per un guidatore umano, dinanzi a un bambino che attraversa improvvisamente la strada, è scontato tentare qualsiasi manovra per evitare l’investimento, pur rischiando la propria incolumità, non altrettanto si può dire per una macchina che, in quanto tale, effettua calcoli di mera probabilità. Se i dati in possesso della vettura dovessero dimostrare che evitare l’impatto è impossibile, oppure che la manovra per salvare il bimbo può portare al sacrificio di altre vite incolpevoli, quale decisione prenderà l’algoritmo che comanda il veicolo? Per quale soluzione propenderà il costruttore che realizza il software di gestione del mezzo? Il portale ideato dal MIT si propone quale base di discussione globale, tentando di fornire una via d’uscita standardizzata nei vari frangenti.

Attraverso il portale Moral Machine è possibile commentare i vari scenari proposti, motivando le ragioni della propria scelta e discutendo con gli altri utenti. L’obiettivo è creare una “coscienza collettiva” in base alla quale i costruttori di vetture senza conducente possano affrontare lo sviluppo dei software di guida autonoma così che risultino non solo efficaci, ma anche moralmente accettabili. La speranza, ovviamente, è che le auto robot non siano mai chiamate a prendere decisioni drastiche, ma trattandosi pur sempre di mezzi meccanici non è escluso che possano incappare in rotture e imprevisti.

La questione delle decisioni “morali” legate alle vetture a guida autonoma è quanto mai attuale e scottante. Il costruttore tedesco Bmw ha da tempo sollevato la questione, consapevole che, sebbene la tecnologia driverless sia quasi pronta, restano da risolvere innumerevoli problemi e interrogativi di ordine legislativo, assicurativo ed etico. In caso di necessità, un’auto senza conducente dovrebbe salvaguardare la vita dei passeggeri, proteggere chi si è dimostrato più ligio al codice della strada o, addirittura, dare la precedenza a bambini, donne incinte e altre categorie “sensibili”? Il dibattito, a livello europeo e mondiale, è aperto.

Siamo anche su WhatsApp. Segui il canale ufficiale LifeGate per restare aggiornata, aggiornato sulle ultime notizie e sulle nostre attività.

![]()

Quest'opera è distribuita con Licenza Creative Commons Attribuzione - Non commerciale - Non opere derivate 4.0 Internazionale.

Uno degli svantaggi delle auto a guida autonoma è nel tempo impiegato per riconoscere gli ostacoli: ora si punta ad arrivare a 20 millisecondi.

Dal super airbag al sistema che impedisce la guida contromano, dallo sharing per disabili al primo retrovisore virtuale, fino alle auto senza conducente. Ecco 5 innovazioni per una mobilità più sicura

Il viaggio virtuoso verso il 2020, l’auto connessa, elettrica, condivisa: per Volkswagen Group Italia, le nuove sfide della mobilità vedono la sostenibilità come parte integrante della strategia aziendale. Ce ne ha parlato Stefano Sordelli a Ecomondo.

Parlare di guida autonoma significa analizzare il futuro e, al tempo stesso, occuparsi della tecnologia V2X, vale a dire della connettività tra veicoli e infrastrutture. Mai come nell’era della mobilità senza conducente, infatti, sarà determinante il costante scambio d’informazioni tra vetture e realtà circostante. Una condivisione basata sulla disponibilità di reti pubbliche e private per

Da fuori è cambiato poco. Anche dentro non è certo una rivoluzione. Però è più comodo, silenzioso, rilassante. E sicuro. Insomma, per ora il nuovo Nissan Qashqai è “solo” migliorato, un “restyling”, come accade a tutte le auto quando si trovano a metà della loro vita. Ma la vera novità arriverà dalla prossima primavera, quando

Il 2020 si avvicina. L’anno fatidico nel quale vedremo circolare le prime auto a guida integralmente autonoma è alle porte e le case costruttrici lavorano a pieno ritmo per affinare i software che gestiranno le vetture. Fra i costruttori impegnati in tal senso spicca il Gruppo Jaguar Land Rover, da tempo dedito alla causa della

La Ford, uno dei colossi del mondo dell’auto, svolta in ottica sostenibile. Il costruttore americano ridisegna la propria ossatura facendo della smart mobility, vale a dire la mobilità “intelligente” e a ridotto impatto ambientale, delle forme di trasporto alternative, in primis il car sharing e il ride sharing, e della guida autonoma i capisaldi del

Salva vite umane, scongiura gli incidenti, risolve i problemi e protegge l’ambiente. No, non è un nuovo supereroe. Più semplicemente, si tratta dell’auto connessa. Vale a dire la vettura del futuro, rigorosamente a propulsione elettrica, o in ogni caso sostenibile, e in perenne contatto sia con gli altri veicoli sia con le infrastrutture. Un singolo

Negli ultimi anni, il termine guida autonoma è entrato prepotentemente nel vocabolario automobilistico. Svariati costruttori vantano già ora dei sistemi di assistenza al conducente definiti “autonomi”, ad esempio Tesla, Mercedes-Benz e Bmw, sebbene al guidatore sia richiesta una soglia di attenzione non inferiore al consueto e, soprattutto, l’uomo sia tuttora chiamato a intervenire nelle situazioni